人工智能如何重塑網絡與信息安全軟件開發 機遇、挑戰與未來

在數字化浪潮席卷全球的今天,網絡安全已成為國家安全、經濟發展和社會穩定的基石。隨著網絡攻擊手段日益復雜化、自動化,傳統的基于規則和簽名的防御體系顯得力不從心。人工智能的崛起,正以前所未有的深度和廣度,重塑著網絡與信息安全軟件開發的格局,帶來了革命性的機遇,也伴隨著不容忽視的挑戰。

一、機遇:AI驅動的主動智能防御

AI技術,特別是機器學習和深度學習,為信息安全軟件開發注入了“智能”與“主動”的新基因。

- 威脅檢測與響應(TDR)的革新: 傳統安全軟件依賴于已知攻擊特征庫(簽名),對零日漏洞和新型高級持續性威脅(APT)反應滯后。AI模型能夠分析海量網絡流量、日志和終端行為數據,學習“正常”行為基線,從而異常精準地識別出偏離基線的可疑活動,實現近乎實時的威脅發現。例如,通過用戶和實體行為分析(UEBA),AI可以識別賬號的異常登錄地點、時間或數據訪問模式,提前預警內部威脅或憑證竊取攻擊。

- 漏洞管理與預測性安全: 開發安全的軟件需要管理海量的代碼漏洞。AI可以輔助進行自動化代碼審計,通過模式識別快速定位潛在的安全漏洞(如SQL注入、緩沖區溢出點),提升開發效率。更進一步,結合大數據分析,AI可以預測哪些系統組件最可能被攻擊者利用,幫助安全團隊優先修補關鍵漏洞,實現從“被動修補”到“主動加固”的轉變。

- 安全運營中心(SOC)的智能化: 安全分析師日常面臨海量告警,極易產生疲勞和誤判。AI驅動的安全編排、自動化與響應(SOAR)平臺,能夠自動關聯、篩選和分類安全事件,甚至執行預設的響應劇本(如隔離受感染主機、阻斷惡意IP),大幅減輕人工負擔,提升事件響應速度與準確性。

- 自適應認證與反欺詐: 在身份安全領域,AI通過分析用戶的多維度行為特征(如打字節奏、鼠標移動、常用設備等),實現動態、隱式的持續身份認證,在提升安全性的同時優化用戶體驗。在金融等領域,AI模型能更有效地識別復雜的交易欺詐模式。

二、挑戰:雙刃劍的另一面

AI在賦能安全的其自身也帶來了新的風險維度,對軟件開發提出了更高要求。

- 對抗性AI攻擊: 攻擊者同樣可以利用AI。他們可以創建“對抗性樣本”來欺騙AI檢測模型,例如,微調惡意軟件代碼使其繞過AI殺毒引擎的檢測;或使用生成式AI(如大型語言模型)制造高度逼真的釣魚郵件和虛假信息(深度偽造),進行社會工程學攻擊。這要求安全軟件必須具備對抗此類“AI對抗攻擊”的韌性。

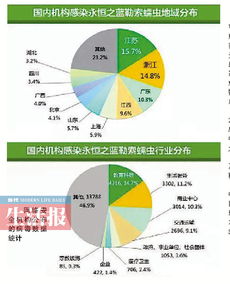

- 數據隱私與算法偏見: AI模型的訓練需要大量數據,其中可能包含敏感信息。如何在利用數據提升安全能力與保護用戶隱私之間取得平衡,是開發中的核心倫理與法律難題。如果訓練數據存在偏差,AI模型可能會產生歧視性判斷,例如錯誤地將特定地域或群體的正常行為標記為異常。

- 模型可解釋性與信任危機: 許多先進的AI模型(尤其是深度學習)如同“黑箱”,其決策過程難以解釋。當AI系統誤封賬號或誤報攻擊時,開發者和用戶難以追溯原因,這影響了系統的可信度和責任界定。開發可解釋的AI(XAI)已成為安全軟件領域的重要研究方向。

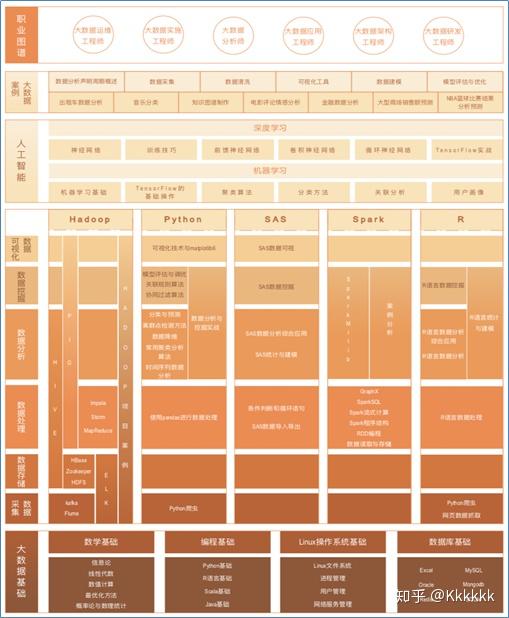

- 技術門檻與資源需求: 集成AI能力需要開發團隊具備數據科學、機器學習等交叉學科知識,模型訓練和推理需要強大的算力支持,這提高了安全軟件的開發與部署成本。

三、未來方向:走向人機協同的智能安全生態

網絡與信息安全軟件的將是深度集成AI的人機協同智能系統。

- 增強智能(Augmented Intelligence): 強調AI作為分析師的“增強”工具,而非完全替代。AI負責處理海量、重復性工作并給出建議,人類專家則專注于戰略決策、復雜關聯分析和應對新型威脅的創造力。軟件設計需更加注重人性化的人機交互界面。

- 隱私計算與聯邦學習: 為解決數據隱私問題,未來的安全軟件將更多采用聯邦學習、差分隱私等技術。模型可以在數據不出本地的情況下進行協同訓練,既匯聚群體智慧,又保障個體數據安全。

- AI安全自身成為標配: “AI安全”模塊將成為下一代安全軟件的必備組件。這包括對AI模型自身的防護(防對抗攻擊)、對其決策的審計與解釋,以及確保其應用符合倫理規范。

- 標準化與協同防御: 行業需要推動AI在網絡安全應用中的標準、框架和最佳實踐,促進不同安全產品之間AI威脅情報的共享與聯動,構建全局性的智能協同防御網絡。

###

人工智能正在將網絡與信息安全軟件開發從“靜態規則”時代推向“動態智能”時代。它極大地提升了我們感知、預測和響應威脅的能力,但同時也引入了新的攻擊面和治理難題。對于開發者而言,關鍵在于以辯證的思維,在積極擁抱AI賦能的必須將AI自身的安全性、可解釋性、公平性和隱私保護內置于軟件開發生命周期的每一個環節。只有這樣,我們才能駕馭這把鋒利的雙刃劍,構筑起真正穩固、可信的智能網絡安全防線。

如若轉載,請注明出處:http://www.17biu.cn/product/63.html

更新時間:2026-04-28 02:06:17